Wd提问

ai生图模型

Ai回答

AI生图模型(AI图像生成模型)是近年来人工智能领域的重要突破,能够根据文本描述、草图或其他输入自动生成高质量图像。以下是关键技术和模型的详细解析:

1、主流AI生图模型

1.1 扩散模型(Diffusion Models)

原理:通过逐步去噪过程生成图像,从随机噪声开始,逐步修复细节。

代表模型:

Stable Diffusion(开源):支持本地部署,效率高,可通过ControlNet插件控制生成细节(如姿势、边缘)。

DALL·E 3(OpenAI):与ChatGPT集成,理解复杂提示词,生成高度匹配文本的图像。

MidJourney:艺术风格突出,适合创意设计,需通过Discord使用。

1.2 生成对抗网络(GANs)

原理:生成器与判别器对抗训练,生成逼真图像。

代表模型:

StyleGAN(NVIDIA):生成高分辨率人脸,支持风格混合(如StyleGAN2ADA)。

BigGAN:适用于多样物体生成,但训练资源消耗大。

1.3 自回归模型(Autoregressive Models)

PixelRNN/CNN:逐像素生成图像,速度慢但质量高,已逐渐被扩散模型取代。

1.4 其他技术

VAEs(变分自编码器):生成图像较模糊,多用于数据压缩。

NeRF(神经辐射场):3D场景重建,可从2D图像生成3D视图。

2、核心功能对比

| 模型 | 优势 | 局限性 | 典型应用场景 |

|

| Stable Diffusion | 开源、插件丰富(如LoRA微调) | 需提示词优化技巧 | 艺术创作、商业设计 |

| DALL·E 3 | 语言理解强,与ChatGPT联动 | 闭源,生成次数限制 | 营销内容、教育素材 |

| MidJourney | 艺术风格独特,易用性高 | 无法本地部署,版权争议 | 概念设计、社交媒体 |

| StyleGAN | 高分辨率人脸生成 | 多样性有限 | 虚拟人物、游戏角色 |

3、关键技术进展

ControlNet:通过边缘图、深度图等控制图像结构,实现精准生成。

LoRA/LyCORIS:小参数微调模型,快速适配特定风格(如动漫、写实)。

LCM(Latent Consistency Models):加速扩散模型推理,实时生成图像。

SDXL 1.0:Stable Diffusion的升级版,提升复杂构图和文本渲染能力。

4、应用场景

创意产业:游戏原画、广告设计、插画创作。

电商:虚拟模特试穿、产品原型生成。

科研:医学图像合成、天文可视化。

社交:个性化头像、表情包生成。

5、使用建议

入门工具:尝试[Leonardo.AI](https://leonardo.ai/)或[DALL·E 3](https://openai.com/dalle)的在线demo。

本地部署:使用Stable Diffusion WebUI(需NVIDIA显卡)。

提示词技巧:明确主体+风格+细节(如赛博朋克风格,未来城市,霓虹灯细节,4K)。

6、伦理与挑战

版权问题:训练数据可能包含未经授权的作品。

深度伪造风险:需警惕AI生成的虚假信息。

解决方案:使用合规数据集(如LAION),添加水印标注AI生成内容。

如需了解具体模型的部署教程或最新动态(如Stable Diffusion 3的发布),可进一步探讨!

1、主流AI生图模型

1.1 扩散模型(Diffusion Models)

原理:通过逐步去噪过程生成图像,从随机噪声开始,逐步修复细节。

代表模型:

Stable Diffusion(开源):支持本地部署,效率高,可通过ControlNet插件控制生成细节(如姿势、边缘)。

DALL·E 3(OpenAI):与ChatGPT集成,理解复杂提示词,生成高度匹配文本的图像。

MidJourney:艺术风格突出,适合创意设计,需通过Discord使用。

1.2 生成对抗网络(GANs)

原理:生成器与判别器对抗训练,生成逼真图像。

代表模型:

StyleGAN(NVIDIA):生成高分辨率人脸,支持风格混合(如StyleGAN2ADA)。

BigGAN:适用于多样物体生成,但训练资源消耗大。

1.3 自回归模型(Autoregressive Models)

PixelRNN/CNN:逐像素生成图像,速度慢但质量高,已逐渐被扩散模型取代。

1.4 其他技术

VAEs(变分自编码器):生成图像较模糊,多用于数据压缩。

NeRF(神经辐射场):3D场景重建,可从2D图像生成3D视图。

2、核心功能对比

| 模型 | 优势 | 局限性 | 典型应用场景 |

|

| Stable Diffusion | 开源、插件丰富(如LoRA微调) | 需提示词优化技巧 | 艺术创作、商业设计 |

| DALL·E 3 | 语言理解强,与ChatGPT联动 | 闭源,生成次数限制 | 营销内容、教育素材 |

| MidJourney | 艺术风格独特,易用性高 | 无法本地部署,版权争议 | 概念设计、社交媒体 |

| StyleGAN | 高分辨率人脸生成 | 多样性有限 | 虚拟人物、游戏角色 |

3、关键技术进展

ControlNet:通过边缘图、深度图等控制图像结构,实现精准生成。

LoRA/LyCORIS:小参数微调模型,快速适配特定风格(如动漫、写实)。

LCM(Latent Consistency Models):加速扩散模型推理,实时生成图像。

SDXL 1.0:Stable Diffusion的升级版,提升复杂构图和文本渲染能力。

4、应用场景

创意产业:游戏原画、广告设计、插画创作。

电商:虚拟模特试穿、产品原型生成。

科研:医学图像合成、天文可视化。

社交:个性化头像、表情包生成。

5、使用建议

入门工具:尝试[Leonardo.AI](https://leonardo.ai/)或[DALL·E 3](https://openai.com/dalle)的在线demo。

本地部署:使用Stable Diffusion WebUI(需NVIDIA显卡)。

提示词技巧:明确主体+风格+细节(如赛博朋克风格,未来城市,霓虹灯细节,4K)。

6、伦理与挑战

版权问题:训练数据可能包含未经授权的作品。

深度伪造风险:需警惕AI生成的虚假信息。

解决方案:使用合规数据集(如LAION),添加水印标注AI生成内容。

如需了解具体模型的部署教程或最新动态(如Stable Diffusion 3的发布),可进一步探讨!

0

IP地址

203.160.194.235

搜索次数

19

提问时间

2025-08-02 22:46:17

商家广告

域名购买

热门提问

域名评估

最新挖掘

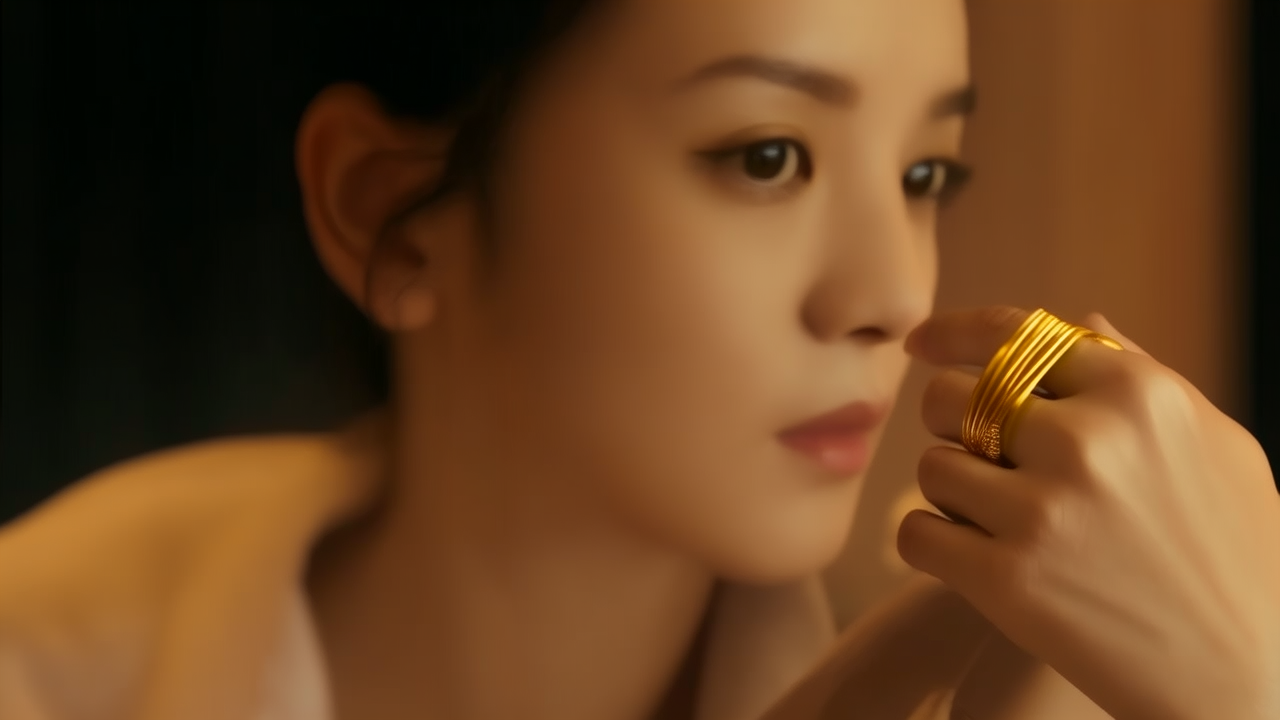

热门作画

关于我们

加入群聊

群聊 1立即加入

群聊 2立即加入

群聊 3立即加入

选择任意群聊,与同好交流分享

友情链接